L’origine concettuale e fisica dello strumento che definiamo macchina fotografica risiede nel principio dell’isolamento ottico dello spazio, un concetto che ha trovato la sua prima e più pura espressione nella camera oscura. Dal punto di vista della fisica ottica, la camera oscura rappresenta un sistema chiuso in cui la propagazione rettilinea della luce viene isolata dalle interferenze dell’ambiente esterno, consentendo la proiezione di un’immagine geometricamente invertita della realtà circostante su una superficie piana parallela all’apertura d’ingresso. Nei modelli più arcaici di camera oscura, l’elemento di selezione dei raggi luminosi era costituito da un semplice foro stenopeico, ovvero una minuscola apertura circolare priva di elementi rifrangenti. La formazione dell’immagine attraverso il foro stenopeico si basa esclusivamente sulla geometria dei raggi rettilinei, dove ogni punto del soggetto emette o riflette un fascio di luce che attraversa l’apertura e proietta un singolo punto corrispondente sul piano di messa a fuoco.

Questo sistema primitivo manifesta un limite fisico invalicabile dettato dalla relazione inversa tra la luminosità della proiezione e la nitidezza dell’immagine risultante. Se il diametro del foro viene allargato per incrementare il flusso luminoso e ridurre i tempi di osservazione, i singoli raggi divergenti provenienti dallo stesso punto del soggetto si sovrappongono sulla superficie di proiezione, determinando un aumento del diametro del circolo di confusione e un conseguente degrado della nitidezza geometrica. Al contrario, se il foro viene ridotto eccessivamente nel tentativo di ottenere la massima definizione possibile, si manifesta il fenomeno ondulatorio della diffrazione, per cui le onde luminose che transitano in prossimità dei bordi dell’apertura subiscono una deviazione geometrica che disperde la luce e sfoca i dettagli più fini dell’immagine proiettata.

Per superare questa barriera fisica, la transizione fondamentale nell’evoluzione della macchina fotografica si compie con l’introduzione della lente ottica, un dispositivo capace di deviare i raggi divergenti e convogliarli verso un unico punto focale sul piano di registrazione attraverso il fenomeno della rifrazione. La legge di Snell regola questo comportamento fisico, stabilendo che la variazione dell’angolo di incidenza della luce nel passaggio tra l’aria e il vetro ottico dipende strettamente dall’indice di rifrazione del materiale vetroso e dalla curvatura geometrica delle superfici della lente. L’equazione dei fabbricanti di lenti esprime matematicamente questa relazione complessa, consentendo di calcolare la lunghezza focale ottimale per focalizzare un piano coniugato nello spazio oggetto su un corrispondente piano nello spazio immagine:

In questa formula, $f$ rappresenta la lunghezza focale complessiva, $n$ indica l’indice di rifrazione del vetro, $R_1$ e $R_2$ descrivono i raggi di curvatura delle due superfici della lente, mentre $d$ esprime lo spessore centrale dell’elemento ottico.

L’inserimento di una singola lente convessa introduce tuttavia gravi aberrazioni ottiche che degradano la qualità della proiezione. Tra queste, l’aberrazione sferica costringe i raggi luminosi che attraversano le porzioni periferiche della lente a focalizzarsi su un piano più vicino rispetto a quelli che transitano lungo l’asse ottico centrale, generando un alone diffuso che riduce drasticamente il contrasto. Parallelamente, l’aberrazione cromatica si manifesta a causa della dispersione ottica del vetro, per cui la lunghezza d’onda della luce blu subisce una deviazione maggiore rispetto alla lunghezza d’onda della luce rossa, portando i diversi colori dello spettro visibile a focalizzarsi su piani differenti e producendo fastidiose frange colorate lungo i contorni ad alto contrasto del soggetto.

La moderna progettazione optomeccanica affronta tali problematiche attraverso l’accoppiamento di elementi ottici con indici di rifrazione e poteri dispersivi differenti, come accade nei doppietti acromatici e nei più complessi schemi apocromatici, dove lenti in vetro crown a bassa dispersione si alternano a lenti in vetro flint ad alta dispersione. Obiettivi moderni di livello professionale, come il celeberrimo Zeiss Otus 55mm f/1.4, rappresentano l’apice di questa ingegneria, combinando superfici asferiche e vetri a dispersione parziale anomala per eliminare quasi completamente ogni traccia di aberrazione cromatica e sferica, garantendo una trasmissione della luce priva di distorsioni geometriche anche alla massima apertura di diaframma di f/1.4.

L’architettura fisica della macchina fotografica deve garantire che l’intero sistema ottico sia montato su un telaio rigido e perfettamente allineato con il piano del sensore o della pellicola. Qualsiasi minima flessione meccanica o deviazione micrometrica della distanza di tiraggio compromette l’uniformità della messa a fuoco sull’intera superficie sensibile, motivo per cui i corpi macchina professionali vengono realizzati utilizzando leghe di magnesio o alluminio aeronautico, materiali stabili che resistono alle dilatazioni termiche e alle sollecitazioni meccaniche del lavoro sul campo.

Il Controllo Cinematico del Tempo e la Meccanica delle Tendine

Il controllo dell’esposizione all’interno della macchina fotografica richiede la regolazione precisa di due parametri fondamentali, ovvero l’intensità del flusso luminoso che attraversa l’obiettivo e la durata temporale dell’esposizione stessa sul piano focale. Mentre il diaframma a iride regola l’apertura geometrica e la profondità di campo, il sistema di otturazione determina il lasso di tempo durante il quale la luce è autorizzata a colpire la superficie fotosensibile. Nelle prime fasi storiche della fotografia, le emulsioni chimiche possedevano una sensibilità estremamente ridotta, imponendo tempi di esposizione di diversi minuti che rendevano superfluo l’impiego di un meccanismo di otturazione rapido; era infatti sufficiente rimuovere manualmente il tappo copriobiettivo e ricollocarlo al termine della posa. L’avvento delle lastre al gelatino-bromuro d’argento e la successiva introduzione della pellicola in rullo hanno tuttavia innalzato drasticamente la rapidità dei processi chimici, rendendo indispensabile lo sviluppo di dispositivi meccanici in grado di operare con precisioni dell’ordine dei millisecondi.

Esistono due macro-categorie principali di otturatori meccanici che hanno definito la storia e la tecnica della macchina fotografica, ciascuna caratterizzata da specifiche proprietà fisiche e costruttive. L’otturatore centrale è posizionato direttamente all’interno del barilotto dell’obiettivo, solitamente in stretta prossimità del piano del diaframma. Esso è costituito da una serie di sottili lamelle metalliche disposte radialmente, le quali si aprono verso l’esterno e si richiudono rapidamente grazie all’azione di molle di tensione caricate meccanicamente o controllate da solenoidi elettromagnetici. Il vantaggio principale di questo schema risiede nella sua capacità di esporre l’intera superficie del sensore nello stesso istante, consentendo la sincronizzazione del flash fotografico a qualsiasi velocità di scatto disponibile, comprese velocità elevate come 1/500s o 1/2000s.

Questa architettura, storicamente impiegata nei sistemi di medio formato come le fotocamere Hasselblad 500C, elimina completamente le distorsioni geometriche tipiche dei soggetti in rapido movimento, ma presenta limiti fisici insormontabili legati all’inerzia meccanica delle lamelle, le quali non possono superare velocità di scatto estreme senza rischiare la rottura per fatica del metallo.

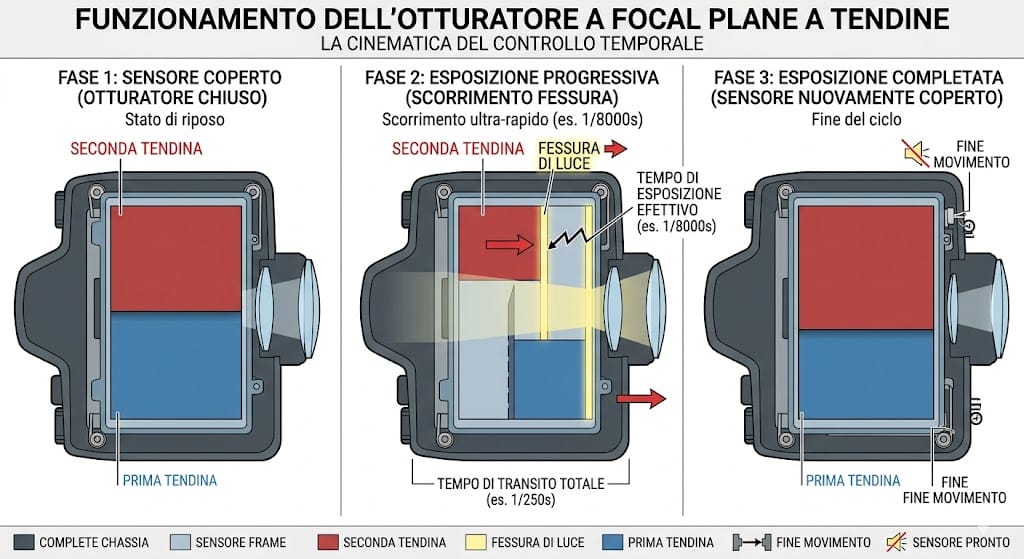

Per raggiungere tempi di posa estremamente rapidi, l’ingegneria fotografica ha sviluppato l’otturatore a tendina, posizionato immediatamente davanti al piano focale. Questo sistema impiega due tendine indipendenti, realizzate storicamente in tessuto gommato e successivamente in titanio o fibra di carbonio ad altissima rigidità, le quali scorrono orizzontalmente o verticalmente lungo la finestra di esposizione. Il funzionamento si basa su una cinematica differenziale altamente sofisticata. A velocità di scatto inferiori al tempo di sincronizzazione flash, che solitamente si attesta intorno a 1/250s, la prima tendina si apre completamente rivelando l’intero sensore, e solo al termine del tempo impostato la seconda tendina si muove per coprire nuovamente la superficie sensibile.

Quando si impostano velocità superiori, come 1/1000s, 1/4000s o l’estremo limite di 1/8000s, la seconda tendina inizia la sua corsa prima che la prima abbia completato il proprio percorso. Questo movimento sincronizzato genera una fessura di luce che scorre lungo il sensore, esponendolo progressivamente sezione per sezione. Sebbene il tempo di esposizione effettivo di ogni singolo punto corrisponda alla velocità ultra-rapida selezionata, il tempo di transito totale della fessura sull’intera altezza del sensore richiede un intervallo temporale più lungo, solitamente pari al tempo di sincronizzazione nativo dello strumento.

La comprensione di questa cinematica è fondamentale per il fotografo professionista, poiché lo scorrimento progressivo della fessura ottica può introdurre distorsioni spaziali nei soggetti che si muovono a velocità angolari superiori rispetto alla velocità di traslazione delle tendine, un fenomeno analogo all’effetto rolling shutter che si riscontra nei sensori digitali moderni privi di un otturatore globale elettronico.

La precisione temporale di questi meccanismi richiede una costante calibrazione delle tensioni delle molle di richiamo e la perfetta lubrificazione delle guide di scorrimento, poiché un micro-rallentamento di una delle due tendine durante la corsa causerebbe un’esposizione non uniforme sul fotogramma, manifestandosi sotto forma di bande chiare o scure lungo i bordi dell’immagine.

La Visione Parallattica e la Meccanica della Riflessione Speculare

La precisione nella composizione dell’inquadratura e l’accuratezza della messa a fuoco dipendono in larga misura dall’efficienza del sistema di mira integrato nella macchina fotografica. Nei sistemi fotografici primordiali, il fotografo era costretto a osservare l’immagine proiettata direttamente sul vetro smerigliato posto sul retro del corpo macchina, una procedura che richiedeva la rimozione dello schermo prima dell’inserimento della lastra sensibile e che rendeva impossibile seguire soggetti in movimento in tempo reale. Per ovviare a questo limite, sono nati i sistemi di mira a traguardo ottico indipendente, i quali utilizzavano un mirino galileiano montato sulla parte superiore dello chassis. Questa configurazione introduceva tuttavia l’inevitabile errore di parallasse, causato dalla distanza fisica tra l’asse ottico del mirino e l’asse ottico dell’obiettivo di ripresa, una discrepanza geometrica che risultava trascurabile nella messa a fuoco all’infinito ma che diventava catastrofica nelle brevi distanze, compromettendo l’accuratezza dell’inquadratura.

L’evoluzione tecnica ha risposto a questa problematica attraverso due percorsi ingegneristici distinti ma ugualmente complessi, ovvero il telemetro accoppiato e il sistema reflex monobiettivo. Nel sistema a telemetro, implementato con straordinaria precisione meccanica nella celebre serie di fotocamere Leica M3, il mirino integra un sistema ottico di triangolazione che combina la visione diretta con un raggio luminoso secondario riflesso da un prisma oscillante. Il prisma è collegato direttamente alla camma di messa a fuoco dell’obiettivo tramite un braccetto caricato a molla situato all’interno del bocchettone d’innesto.

Ruotando la ghiera dell’obiettivo, il fotografo osserva la sovrapposizione di due immagini distinte all’interno di una piccola area centrale del mirino. L’allineamento perfetto e la coincidenza geometrica delle due proiezioni indicano che l’obiettivo è regolato sulla corretta distanza di messa a fuoco, garantendo una precisione estrema che prescinde dalla luminosità massima dell’ottica montata sul corpo macchina.

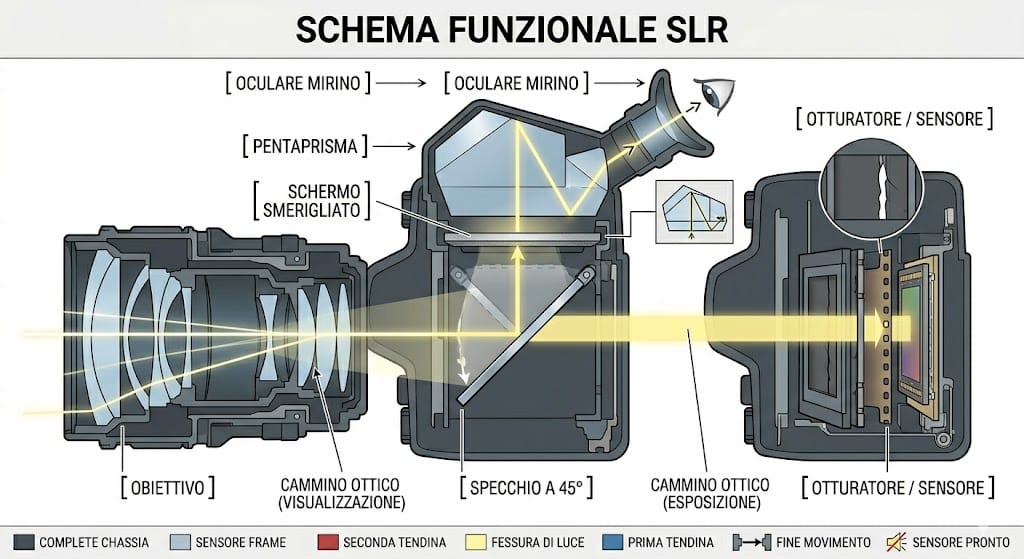

La vera rivoluzione nella visione diretta si compie tuttavia con lo sviluppo della macchina fotografica reflex a singolo obiettivo, nota comunemente con l’acronimo SLR. In questa complessa configurazione meccanica, la luce che attraversa l’obiettivo incontra uno specchio reflex inclinato a un angolo di 45° rispetto all’asse ottico principale, il quale devia il flusso luminoso verso l’alto, proiettandolo su uno schermo di messa a fuoco smerigliato posizionato sulla parte superiore del pozzetto. Al di sopra dello schermo, un prisma a riflessione totale, tipicamente un pentaprisma di vetro ottico a base solida, effettua una serie di tre riflessioni interne che raddrizzano l’immagine sia verticalmente sia orizzontalmente, consentendo al fotografo di osservare nel mirino oculare l’esatta porzione di spazio inquadrata dall’obiettivo, priva di qualsiasi errore di parallasse.

La complessità del sistema SLR risiede nella necessità di liberare il percorso ottico un istante prima che l’otturatore si apra per consentire l’esposizione. Lo specchio reflex deve essere incernierato e collegato a un cinematismo ad altissima velocità in grado di sollevarlo in pochi millisecondi verso la parte superiore della camera specchio, un movimento violento che genera forti vibrazioni strutturali note come mirror slap. Per mitigare queste vibrazioni, che rischiano di indurre micro-mosso nell’immagine durante tempi di scatto critici come 1/15s o 1/30s, i progettisti meccanici integrano sofisticati sistemi di ammortizzazione ad aria o a gel siliconici, abbinati a meccanismi di ritorno istantaneo che riportano lo specchio nella posizione di mira originaria non appena l’esposizione è terminata.

La transizione tecnologica contemporanea ha infine portato all’eliminazione dello specchio e del pentaprisma con l’avvento dei sistemi mirrorless, in cui il flusso luminoso colpisce costantemente il sensore di imaging, il quale invia una lettura elettronica continua ad altissima velocità a un display micro-OLED integrato nel mirino elettronico. Questa architettura non solo elimina l’usura meccanica e il rumore dello specchio in movimento, ma consente la previsualizzazione in tempo reale dell’esposizione effettiva e della profondità di campo prima di premere il pulsante di scatto.

Dalla Reazione dell’Alogenuro d’Argento alla Fotonica del Silicio

La registrazione permanente dell’immagine all’interno della macchina fotografica rappresenta un processo di cattura energetica che ha subito una transizione epistemologica radicale, passando dalla fotochimica dei sali d’argento allo stato solido della microelettronica del silicio. Nel sistema analogico, il mezzo di memorizzazione e di rilevamento coincideva nella pellicola fotografica, un supporto flessibile di triacetato di cellulosa o poliestere rivestito da un’emulsione di gelatina contenente cristalli microscopici di alogenuro d’argento, tipicamente bromuro o ioduro d’argento. Il processo chimico si avvia quando un fotone colpisce il cristallo, eccitando un elettrone che si sposta nella banda di conduzione e viene catturato da un difetto strutturale del reticolo cristallino noto come centro di sensibilità. Questo accumulo di carica negativa attrae gli ioni d’argento interstiziali presenti nel cristallo, riducendoli ad atomi di argento metallico libero che costituiscono il nucleo dell’immagine latente.

La sensitometria descrive quantitativamente questo fenomeno attraverso la curva caratteristica di Hurter e Driffield, che mette in relazione il logaritmo dell’esposizione con la densità ottica ottenuta dopo lo sviluppo chimico. La curva evidenzia tre regioni distinte: il piede della curva, dove l’esposizione è insufficiente per superare la soglia minima di reazione dei sali d’argento; il tratto lineare, in cui la densità aumenta proporzionalmente all’esposizione definendo la latitudine di posa e il contrasto nativo dell’emulsione; e la spalla della curva, dove i cristalli d’argento sono quasi interamente ridotti e si manifesta la saturazione chimica, impedendo la registrazione di ulteriori dettagli nelle alte luci.

L’avvento del sensore digitale ha sostituito questo processo chimico irreversibile con la fisica dei semiconduttori, sfruttando l’effetto fotoelettrico per convertire i fotoni incidenti in cariche elettriche misurabili. In un sensore moderno con tecnologia CMOS, ogni singolo pixel è costituito da un fotodiodo di silicio drogato che funge da pozzo di potenziale. Quando un fotone penetra nel silicio, cede la propria energia a un elettrone della banda di valenza, permettendogli di superare il bandgap energetico e di accedere alla banda di conduzione, generando così una coppia elettrone-lacuna. La quantità di carica accumulata all’interno di ciascun fotodiodo durante l’intervallo di esposizione è direttamente proporzionale all’intensità del flusso luminoso incidente e alla durata del tempo di scatto.

L’efficienza di questo processo è definita dall’efficienza quantica, che esprime la percentuale di fotoni convertiti con successo in elettroni. Per ottimizzare la cattura dei fotoni e massimizzare la sensibilità del sensore, i produttori applicano una matrice di micro-lenti sulla superficie del chip, le quali deviano la luce che colpisce le aree non sensibili del circuito integrato convogliandola direttamente al centro del fotodiodo. Poiché il silicio è intrinsecamente sensibile esclusivamente all’intensità dell’energia luminosa e non alla sua componente cromatica, per ottenere un’immagine a colori si rende necessaria l’applicazione di un filtro di selezione spettrale, comunemente noto come matrice di Bayer. Questo filtro organizza i pixel in un pattern ripetuto composto da due elementi verdi, uno rosso e uno blu, una distribuzione calibrata per emulare la curva di sensibilità del sistema visivo umano, che possiede una risoluzione spaziale nettamente superiore per le lunghezze d’onda associate alla luminanza verde.

La ricostruzione del segnale cromatico completo avviene successivamente a livello software attraverso sofisticati algoritmi di demosaicizzazione, i quali interpolano i valori dei pixel adiacenti per ricostruire i tre canali colore fondamentali per ciascun punto dell’immagine. La qualità finale del file generato dipende in larga misura dal processo di quantizzazione analogico-digitale, che traduce la tensione elettrica in uscita da ciascun fotodiodo in un valore binario codificato.

La generazione di un file raw non compresso preserva l’integrità di queste informazioni grezze, consentendo al fotografo di intervenire nelle fasi di post-produzione attraverso lo Sviluppo di Camera Raw per calibrare parametri sensibili quali l’esposizione, il recupero delle ombre e il contrasto tonale senza introdurre artefatti di compressione distruttiva.

La Calibrazione Metrologica dell’Esposizione e la Gestione dei Flussi Dati

Il funzionamento ottimale di una macchina fotografica contemporanea richiede l’integrazione di sistemi metrologici in grado di analizzare la luce in tempo reale per determinare la corretta terna espositiva, formata da tempo di posa, apertura del diaframma e sensibilità ISO secondo gli standard definiti dalla International Organization for Standardization. L’esposimetro integrato nel corpo macchina esegue una misurazione della luce riflessa dal soggetto, interpretando la scena in base a un algoritmo di calibrazione tarato sul valore medio del grigio medio con riflettanza pari al 18%.

I moderni sistemi di misurazione esposimetrica utilizzano sensori RGB ad altissima risoluzione per suddividere l’inquadratura in centinaia di zone indipendenti, confrontando i dati di luminanza e di distribuzione cromatica con un database interno di scene di riferimento attraverso la misurazione valutativa o Matrix. Questo approccio protegge le alte luci dal rischio di clipping digitale e assicura una corretta interpretazione dei soggetti caratterizzati da forti contrasti di chiaroscuro.

Parallelamente al controllo dell’esposizione, il sistema di messa a fuoco automatica rappresenta uno degli elementi tecnologici di maggiore complessità all’interno della macchina fotografica. Esistono due tecnologie principali per il rilevamento del fuoco, ovvero il rilevamento di contrasto e il rilevamento di fase. Il rilevamento di contrasto analizza direttamente le informazioni provenienti dal sensore principale, muovendo il gruppo ottico avanti e indietro finché non individua il picco massimo di contrasto ad alta frequenza spaziale tra pixel adiacenti, un metodo estremamente preciso ma intrinsecamente lento e soggetto all’effetto di hunting.

Il rilevamento di fase, mutuato concettualmente dai sistemi a telemetro, sdoppia l’immagine in ingresso indirizzandola verso coppie di sensori lineari dedicati o integrando fotodiodi sdoppiati direttamente sulla superficie del sensore principale. Calcolando la sfasatura geometrica tra i due segnali d’immagine, il sistema è in grado di determinare istantaneamente non solo se il soggetto è a fuoco, ma anche la direzione esatta e l’entità dello spostamento meccanico necessario per raggiungere il punto di fuoco ideale, garantendo una tracciabilità continua anche in scenari sportivi ad alta dinamicità.

La gestione elettronica dei flussi di dati generati da sensori ad altissima risoluzione richiede processori d’immagine dedicati con larghezze di banda colossali. Quando la macchina fotografica opera in modalità di acquisizione video professionale, la gestione del bitrate diventa un fattore critico per prevenire il surriscaldamento dei circuiti interni e la saturazione del buffer di memoria. L’ottimizzazione bitrate video fotocamere si ottiene attraverso l’adozione di formati di compressione avanzati sia di tipo inter-frame, in cui vengono codificate esclusivamente le differenze visive tra fotogrammi successivi, sia intra-frame, dove ogni singolo fotogramma viene elaborato e memorizzato in modo indipendente per facilitare le operazioni di montaggio non lineare.

La precisione del colore in questi flussi video è garantita dall’adozione di un campionamento colore 4:2:2, che dimezza la risoluzione orizzontale dei dati di crominanza mantenendo inalterata la risoluzione della luminanza, una configurazione ideale per sopportare pesanti interventi di color grading e calibrazioni cromatiche complesse in fase di post-produzione.

Nel controllo delle alte sensibilità, la gestione del rumore elettronico rappresenta un’ulteriore sfida ingegneristica. Quando il fotografo innalza la sensibilità ISO a valori elevati come ISO 6400 o superiori, il sensore non aumenta l’efficienza fisica dei fotodiodi, bensì applica un’amplificazione analogica e successivamente digitale al segnale elettrico in uscita dai pixel. Questa operazione amplifica inevitabilmente anche il rumore di fondo intrinseco del sistema, dovuto al rumore termico e al rumore di lettura dei circuiti.

La riduzione del rumore ad alti ISO viene gestita attivamente dall’hardware della macchina fotografica attraverso l’applicazione di algoritmi di filtraggio spaziale e temporale che isolano il rumore cromatitico e di luminanza preservando al contempo la micro-nitidezza dei dettagli fini, un delicato bilanciamento che può essere rifinito manualmente in post-produzione applicando una Maschera di Contrasto o algoritmi di deconvoluzione avanzati sui file raw.

L’Integrazione Ottico-Computazionale e la Sintesi Percettiva Contemporanea

La macchina fotografica contemporanea ha superato il concetto tradizionale di strumento ottico-meccanico passivo per trasformarsi in un sistema computazionale integrato ad altissima precisione. In questa nuova dimensione tecnologica, la barriera fisica rappresentata dai limiti costruttivi delle lenti in vetro e dalle dimensioni geometriche del sensore viene costantemente superata attraverso l’elaborazione software in tempo reale. I moderni obiettivi non vengono più progettati esclusivamente per raggiungere la perfezione geometrica pura; i produttori accettano la presenza di una moderata distorsione o di una leggera vignettatura ai bordi per poter ridurre le dimensioni fisiche e il peso del barilotto, affidando la correzione matematica di queste aberrazioni a profili di calibrazione digitali incorporati direttamente all’interno dei metadati del file raw. Durante la fase di acquisizione, il processore d’immagine applica istantaneamente queste correzioni geometriche, restituendo un’inquadratura perfettamente rettilinea e uniforme sull’intero campo visivo.

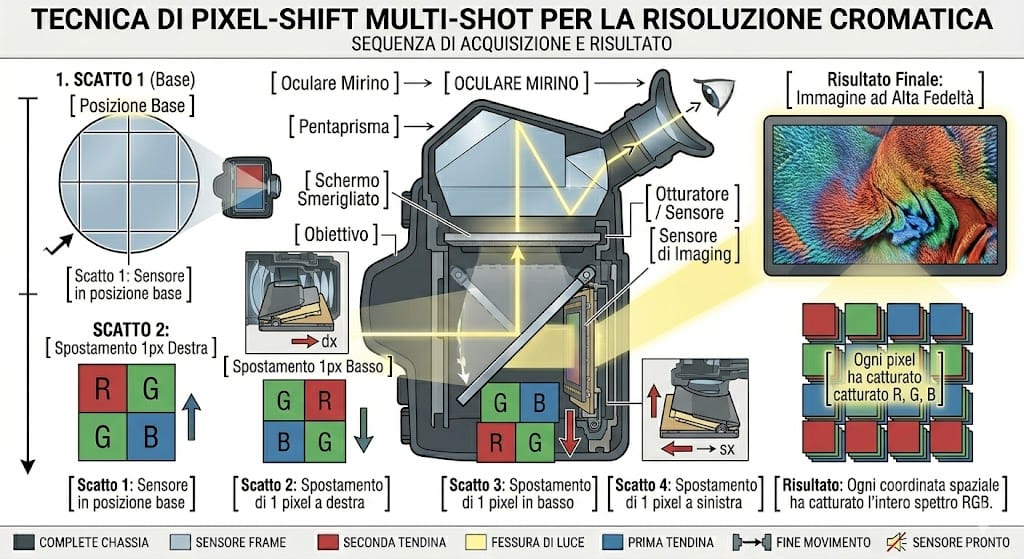

Questo paradigma computazionale trova la sua espressione più avanzata nella tecnologia di spostamento del sensore, nota come pixel shift multi-shot, implementata nei sistemi di medio formato digitale come il Phase One XF. Grazie a motori piezoelettrici ad altissima precisione che muovono il supporto del sensore con tolleranze inferiori al micron, la macchina fotografica esegue una sequenza rapida di scatti successivi, spostando il sensore di un pixel esatto tra un’esposizione e l’altra. Questo movimento consente a ciascun pixel del sensore di registrare le informazioni luminose attraverso tutti i filtri della matrice di Bayer, ovvero rosso, verde e blu, eliminando la necessità dell’interpolazione cromatica e quadruplicando la reale risoluzione del sensore.

L’immagine risultante vanta una fedeltà cromatica assoluta e l’assenza totale di fenomeni di moiré spaziale, fornendo un livello di dettaglio precedentemente raggiungibile solo attraverso complessi banchi ottici di grande formato.

Un ulteriore limite fisico affrontato dalla fotografia computazionale è rappresentato dal fenomeno della diffrazione. Quando il fotografo seleziona diaframmi molto chiusi, come f/16 o f/22, nel tentativo di ottenere la massima profondità di campo possibile sull’intera scena, la deviazione ondulatoria della luce distorce i fronti d’onda in prossimità del sensore, ammorbidendo l’immagine e riducendo la nitidezza percepita.

I moderni motori di elaborazione integrati nei corpi macchina contengono algoritmi di ottimizzazione dell’obiettivo che applicano filtri di deconvoluzione spaziale, calcolando matematicamente la funzione di diffusione del punto per ripristinare il contrasto ad alta frequenza perduto a causa del transito attraverso aperture geometriche ridotte.

La convergenza definitiva tra informatica e ottica si manifesta nell’introduzione di sensori dotati di un otturatore globale elettronico. Questa tecnologia consente la lettura simultanea del segnale elettrico accumulato da tutti i fotodiodi del sensore in un singolo istante temporale, eliminando completamente la necessità di tendine meccaniche o di scansioni progressive riga per riga. L’adozione dell’otturatore globale azzera ogni forma di distorsione geometrica nei soggetti ad altissima velocità e rende possibile la sincronizzazione del flash fotografico a qualsiasi tempo di scatto immaginabile, consentendo di controllare la luce naturale esterna anche a diaframmi spalancati sotto il sole battente.

La macchina fotografica si configura così non più come un semplice registratore di eventi fisici, bensì come un sofisticato sintetizzatore di informazioni spaziali e temporali, dove la fusione tra la precisione della meccanica fine, la purezza dell’ottica e la potenza di calcolo del silicio ridefinisce costantemente i confini della rappresentazione visiva.

Fonti

Adonis, J. (2021). The Physics of Digital Imaging: From Photoelectric Effect to Modern CMOS Architectures. Academic Press.

George Eastman Museum Archives. The Evolution of Photographic Materials and Camera Mechanisms. George Eastman Museum.

Hasselblad Systems. The Mechanics of Leaf Shutters and Medium Format Optics. Hasselblad Official Documentation.

International Organization for Standardization. ISO 12232:2019 – Photography — Digital still cameras — Determination of exposure index, ISO speed ratings, standard output sensitivity, and recommended exposure index. ISO Standards.

Leica Camera AG. Rangefinder Design and Telemetric Calibration in the M Series. Leica Technical Journal.

Phase One. Medium Format Aerial and Heritage Imaging Systems. Phase One Technologies.

Ray, S. F. (2002). Applied Photographic Optics: Lenses and Optical Systems for Photography. Focal Press.

Zeiss, C. (2018). Optical Aberrations, Dispersion and Lens Correction Systems. Zeiss International.

Sono Manuela Parangelo, autrice e amministratrice di storiadellafotografia.com, uno dei principali siti italiani dedicati alla storia e alla cultura fotografica. La mia passione per la fotografia è nata molti anni fa e da allora ho dedicato la mia vita professionale a esplorare, ricercare e condividere tutto ciò che riguarda questo straordinario linguaggio visivo.

Con una solida formazione accademica in storia dell’arte e una lunga esperienza nella cura di mostre fotografiche e nella pubblicazione di articoli su riviste specializzate, ho sviluppato una visione ampia e critica della fotografia in tutte le sue dimensioni. Su storiadellafotografia.com mi occupo dei brand fotografici che hanno fatto la storia del mezzo: Leica, Hasselblad, Kodak, Nikon, Canon e tutti i marchi che con le proprie innovazioni hanno reso possibile la fotografia così come la conosciamo oggi.

Racconto i maestri della fotografia, i grandi autori che hanno definito il linguaggio visivo del Novecento e del nostro tempo, restituendo a ciascuno il contesto storico e culturale che ne rende comprensibile la grandezza. Mi occupo della storia della fotografia nelle sue tappe fondamentali, dai primi esperimenti ottocenteschi alla rivoluzione digitale contemporanea, con particolare attenzione alle intersezioni tra fotografia, cultura e società.

Curo gli editoriali del sito e condivido curiosità fotografiche, gli aneddoti e i retroscena che rendono il mondo della fotografia ancora più affascinante di quanto sembri in superficie.

La mia missione è educare e ispirare, con un approccio che unisce il rigore della ricerca accademica alla chiarezza della divulgazione, per avvicinare un pubblico ampio a una forma d’arte che è al tempo stesso documento storico, strumento di comunicazione e archivio della memoria collettiva.