Quando si preme il pulsante di scatto di una fotocamera digitale moderna, accade qualcosa di straordinariamente complesso in una frazione di secondo. La luce entra attraverso l’obiettivo, attraversa una serie di filtri ottici, colpisce milioni di fotodiodi disposti su una superficie delle dimensioni di un francobollo o poco più, viene convertita in segnale elettrico, amplificata, campionata, convertita in valori numerici, elaborata da un processore dedicato, compressa secondo algoritmi specifici e scritta su una scheda di memoria. Tutto questo accade in meno tempo di quanto l’occhio umano impieghi a percepire il lampo del flash. Comprendere questa catena di trasformazioni non è un esercizio di ingegneria fine a sé stesso: è la condizione per capire perché certe fotocamere si comportano in un certo modo, perché certi limiti tecnici esistono e come aggirarli, perché le scelte di progetto dei costruttori producono differenze visibili nelle immagini finali.

La fotocamera digitale è, nella sua essenza, un sistema di conversione: trasforma la luce in dati, e poi trasforma i dati in immagini. Ogni fase di questa doppia trasformazione introduce variabili che il fotografo consapevole deve conoscere, non necessariamente nei dettagli ingegneristici, ma nella loro logica funzionale e nelle loro conseguenze pratiche. La qualità dell’immagine finale non dipende solo dall’obiettivo o dalla sensibilità ISO impostata: dipende dall’intera catena di elaborazione, dal sensore al file salvato sulla scheda, e ogni anello di questa catena ha le proprie caratteristiche, i propri punti di forza e i propri limiti.

Il Sensore: La Retina della Fotocamera Digitale

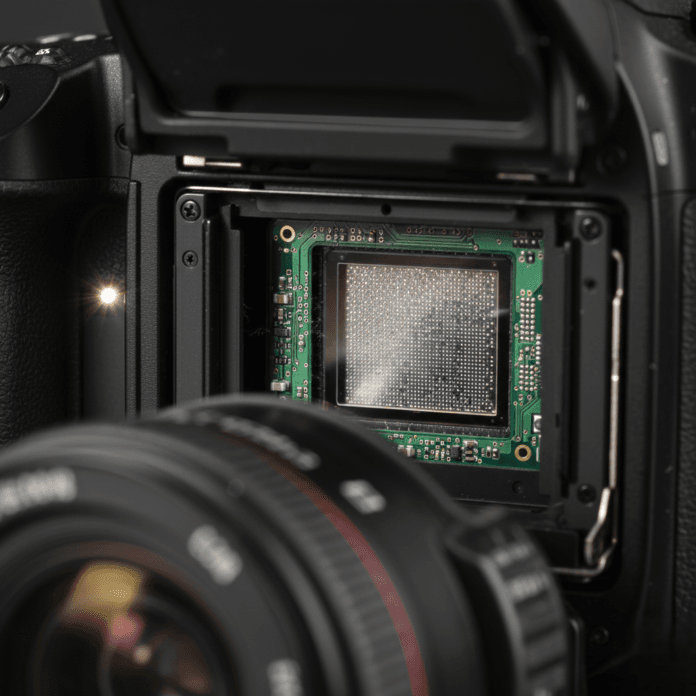

Il sensore fotografico è il componente attorno a cui si organizza l’intera architettura della fotocamera digitale. È una superficie di silicio ricoperta da milioni di fotodiodi, ciascuno dei quali converte i fotoni che lo colpiscono in una carica elettrica proporzionale all’intensità della luce ricevuta. Ogni fotodiodo corrisponde a un pixel dell’immagine finale, e la sua capacità di raccogliere fotoni, misurata in elettroni, determina il range dinamico che il sensore può catturare: un fotodiodo che può accumulare molti elettroni prima di saturarsi sarà in grado di gestire scene ad alto contrasto meglio di uno con capacità ridotta.

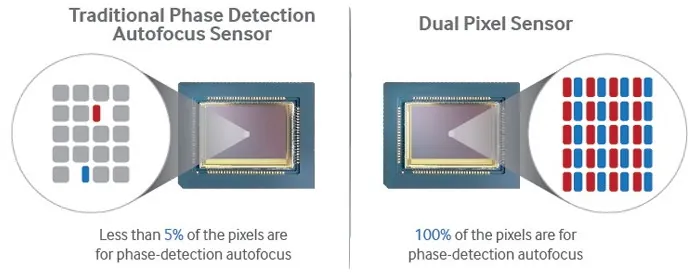

La tecnologia dominante nei sensori fotografici è il CMOS, Complementary Metal-Oxide Semiconductor, che ha sostituito progressivamente la tecnologia CCD a partire dagli anni Duemila. Il vantaggio del CMOS non risiede solo nella minore dissipazione di energia: la possibilità di integrare sul chip del sensore stesso circuiti di elaborazione del segnale ha permesso di ridurre il rumore di lettura, di aumentare la velocità di lettura dei dati e di implementare funzioni come il dual pixel autofocus direttamente nel silicio. L’integrazione è il principio che ha guidato l’evoluzione dei sensori negli ultimi vent’anni: portare sempre più funzioni sempre più vicine al punto di acquisizione del segnale, riducendo il percorso che il segnale deve compiere prima di essere elaborato e quindi riducendo le opportunità di degradazione.

Le dimensioni fisiche del sensore sono uno dei parametri più discussi e spesso più fraintesi nel dibattito fotografico. La dimensione del sensore influenza direttamente la dimensione fisica di ciascun fotodiodo, a parità di risoluzione in megapixel: un sensore full frame da 24 megapixel ha fotodiodi significativamente più grandi di un sensore micro quattro terzi con la stessa risoluzione, e fotodiodi più grandi raccolgono più fotoni per unità di tempo, producendo un segnale più forte e quindi un rapporto segnale/rumore migliore, soprattutto alle alte sensibilità ISO. Ma la dimensione del sensore determina anche la lunghezza focale equivalente degli obiettivi, la profondità di campo per una data apertura e angolo di campo, e il sistema di obiettivi compatibili: scegliere un formato di sensore è scegliere un sistema fotografico complessivo, non solo una caratteristica tecnica isolata.

Filtri Ottici: Ciò che il Sensore Non Deve Vedere

Tra l’obiettivo e il sensore si trovano componenti che raramente vengono menzionati nelle specifiche delle fotocamere ma che hanno un impatto diretto sulla qualità dell’immagine: i filtri ottici che condizionano quali lunghezze d’onda della luce raggiungono il sensore e in quale misura.

Il filtro IR Cut è il primo di questi componenti: il silicio dei sensori CMOS è naturalmente sensibile alla luce infrarossa, che l’occhio umano non percepisce ma che se non filtrata altererebbe significativamente i colori dell’immagine, rendendo i verdi della vegetazione quasi bianchi e modificando la resa cromatica complessiva. Il filtro IR cut blocca selettivamente le lunghezze d’onda infrarosse, permettendo al sensore di rispondere solo alla luce visibile. È un componente invisibile nell’uso ordinario ma la cui rimozione o sostituzione è al centro della pratica della fotografia infrarossa modificata, in cui le fotocamere vengono appositamente convertite rimuovendo o sostituendo questo filtro per permettere al sensore di catturare le lunghezze d’onda IR.

Il filtro passa basso, detto anche filtro anti-aliasing, ha una funzione diversa e più sottile: riduce la nitidezza ottica dell’immagine prima che questa raggiunga il sensore, attenuando i dettagli più fini che potrebbero generare artefatti di moiré quando vengono campionati dalla griglia regolare dei pixel. Il moiré è un pattern di interferenza che appare quando una struttura regolare fine, come il tessuto di una camicia a righe sottili o una reticella metallica, viene fotografata con un sensore la cui frequenza di campionamento spaziale è insufficiente a risolvere quella struttura. Il filtro passa basso previene il problema alla radice, ma al costo di una lieve perdita di nitidezza. Questo compromesso ha generato un dibattito che dura da decenni: alcuni costruttori hanno eliminato il filtro passa basso dai propri sensori di alta risoluzione, scommettendo che la maggiore risoluzione compensasse il rischio di moiré, altri lo hanno mantenuto, altri ancora hanno sviluppato sistemi di filtro passa basso che possono essere disattivati elettronicamente.

La Conversione Analogico-Digitale: Dove la Luce Diventa Numero

Il segnale elettrico prodotto dal sensore è analogico: una tensione variabile che rappresenta l’intensità della luce ricevuta da ciascun fotodiodo con una continuità teoricamente infinita. Per diventare un file digitale deve essere convertito in valori numerici discreti, e questa operazione è affidata al convertitore analogico-digitale.

La qualità del convertitore ADC si misura principalmente in bit di profondità: un convertitore a 12 bit produce 4096 livelli di grigio per canale, uno a 14 bit ne produce 16384, uno a 16 bit ne produce 65536. Maggiore è la profondità di bit, maggiore è la finezza con cui le graduazioni tonali vengono rappresentate, e maggiore è lo spazio disponibile per la correzione in post-produzione senza introdurre posterizzazione o artefatti visibili. I file RAW delle fotocamere moderne catturano tipicamente a 14 o 16 bit, anche se spesso vengono visualizzati e consegnati in formati a 8 bit come il JPEG: la differenza non è visibile nell’immagine finale in condizioni normali, ma diventa cruciale quando si lavora su recupero delle alte luci, correzione delle ombre o gestione del colore in post-produzione.

La velocità del convertitore ADC è un altro parametro critico: in una fotocamera che può scattare 20 o 30 fotogrammi al secondo, il convertitore deve elaborare decine di milioni di pixel per ogni fotogramma, il che significa miliardi di conversioni al secondo. Questa velocità di elaborazione è una delle ragioni per cui i sensori moderni di fascia alta incorporano più convertitori ADC in parallelo, ciascuno responsabile di una porzione del sensore, invece di usare un singolo convertitore centralizzato.

Il Processore d’Immagine: Il Cervello del Sistema

Se il sensore è la retina della fotocamera, il processore d’immagine ne è il cervello: il chip dedicato che riceve i dati grezzi dal sensore e li trasforma in un’immagine utilizzabile, applicando demosaicizzazione, riduzione del rumore, correzione della distorsione ottica, gestione del colore, compressione JPEG e decine di altre operazioni in tempo reale.

La demosaicizzazione è la prima e più fondamentale di queste operazioni: i sensori fotografici convenzionali non catturano il colore direttamente, ma usano un filtro a matrice di Bayer, una griglia di filtri colorati rosso, verde e blu disposti in pattern regolare sopra i fotodiodi, con il verde rappresentato il doppio delle altre due componenti per rispecchiare la maggiore sensibilità dell’occhio umano alle lunghezze d’onda verdi. Ogni pixel cattura quindi informazioni su un solo canale cromatico, e il processore deve interpolare i valori mancanti degli altri due canali per ciascun pixel usando le informazioni dei pixel adiacenti. Gli algoritmi di demosaicizzazione sono complessi e hanno un impatto diretto sulla nitidezza percepita, sulla gestione delle transizioni cromatiche e sulla comparsa di artefatti nelle aree di alto contrasto.

La riduzione del rumore è un’altra operazione critica: i sensori producono rumore casuale che aumenta alle alte sensibilità ISO, e il processore applica algoritmi di filtraggio per attenuarlo. Il compromesso fondamentale qui è tra riduzione del rumore e preservazione dei dettagli: un algoritmo aggressivo elimina il rumore ma ammorbidisce anche i dettagli fini, un algoritmo conservativo preserva i dettagli ma lascia visibile la granulosità. I processori moderni usano algoritmi adattativi che applicano diversi livelli di riduzione del rumore in diverse aree dell’immagine in base all’analisi locale del contenuto, e le implementazioni basate su reti neurali degli ultimi anni hanno migliorato significativamente la capacità di distinguere il rumore casuale dai dettagli reali.

Il buffer di memoria è il componente che permette al processore di lavorare senza bloccare la cattura: quando si fotografa in burst ad alta velocità, i dati arrivano dal sensore più velocemente di quanto il processore riesca a elaborarli e più velocemente di quanto la scheda di memoria riesca ad accettarli. Il buffer è una memoria ad alta velocità che accumula i dati grezzi in attesa che processore e scheda di memoria li smaltiscano. La dimensione del buffer determina quanti fotogrammi consecutivi si possono scattare prima che la fotocamera rallenti in attesa che il buffer si svuoti: un buffer da 200 fotogrammi RAW permette sequenze di azione molto più lunghe di uno da 50.

La Messa a Fuoco Automatica: Velocità, Precisione e Intelligenza

Il sistema di autofocus delle fotocamere digitali moderne è diventato negli ultimi anni uno degli ambiti di maggiore innovazione tecnologica, con prestazioni che avrebbero sembrato fantascientifiche anche solo un decennio fa.

Il Dual Pixel AF, introdotto da Canon e poi adottato in forme diverse da altri costruttori, rappresenta un salto qualitativo rispetto ai sistemi di rilevamento di contrasto tradizionali: ogni fotodiodo del sensore è diviso in due sottopixel che possono essere letti separatamente, permettendo un rilevamento di fase direttamente sul sensore principale invece che su sensori AF dedicati. Il rilevamento di fase calcola la direzione e l’entità della messa a fuoco necessaria analizzando la disparità tra i segnali dei due sottopixel, producendo una correzione immediata e diretta invece della ricerca iterativa del contrasto massimo. Il risultato è un autofocus significativamente più veloce e più affidabile, soprattutto in condizioni di luce scarsa e con soggetti in movimento.

Il tracking 3D nella messa a fuoco porta questa logica a un livello superiore: invece di mantenere la messa a fuoco su un punto fisso del fotogramma, il sistema segue un soggetto identificato attraverso l’analisi continua del frame, adattando la posizione del punto AF ai movimenti del soggetto nella scena. I sistemi moderni usano reti neurali addestrate su milioni di immagini per identificare e seguire soggetti specifici, occhi umani, animali, veicoli, con una precisione e una robustezza che i sistemi basati solo su algoritmi convenzionali non potevano raggiungere.

I motori AF delle ottiche sono il componente meccanico che traduce i comandi del sistema AF in movimento fisico dei gruppi di lenti. Le differenze tra i diversi tipi di motore, USM ultrasonico, STM a passo, lineare, non sono solo di velocità: riguardano la fluidità del movimento, la silenziosità e la linearità della risposta, caratteristiche critiche per applicazioni video in cui un motore rumoroso o a scatti comprometterebbe sia la qualità audio sia la fluidità del rack focus.

Stabilizzazione e Mirino: L’Interfaccia con il Fotografo

La stabilizzazione elettronica dell’immagine è una delle tecnologie che meglio illustra i compromessi inevitabili nella progettazione di sistemi fotografici: a differenza della stabilizzazione ottica, che sposta fisicamente un gruppo di lenti per compensare le vibrazioni, o della stabilizzazione sul sensore, che sposta fisicamente il sensore, la stabilizzazione elettronica funziona ritagliando il frame registrato e interpolando tra frame successivi per eliminare i movimenti indesiderati. Non richiede meccanismi aggiuntivi ed è praticamente gratuita dal punto di vista dei costi di produzione, ma ha un costo preciso in termini di qualità dell’immagine: il ritaglio riduce il campo visivo e la qualità ottica, e l’interpolazione tra frame può introdurre artefatti nelle aree di movimento rapido. È una tecnologia che funziona bene per video casuali ripresi con smartphone, meno bene per riprese professionali dove ogni pixel conta.

Il mirino ibrido ottico-elettronico chiude il cerchio dell’interfaccia tra il sistema digitale e il fotografo: è il punto in cui tutta l’elaborazione che avviene all’interno della fotocamera si rende visibile e utilizzabile. La possibilità di alternare tra la visione ottica diretta, senza latenza e con la naturalezza dell’osservazione del mondo reale, e la visione elettronica, con tutte le sovrapposizioni di dati e la simulazione dell’esposizione finale, rappresenta un approccio filosofico preciso al rapporto tra tecnologia e percezione. Non scegliere definitivamente tra analogico e digitale, ma tenere entrambi disponibili e lasciare al fotografo la decisione su quale usare in quale momento: è una soluzione pragmatica che rispetta sia la tradizione della visione diretta sia le possibilità della visualizzazione digitale.

Una Catena Senza Anelli Deboli

Ciò che emerge da questa analisi dei componenti digitali della fotocamera moderna è la natura profondamente sistemica del mezzo fotografico contemporaneo. Ogni componente, dal filtro IR cut al buffer di memoria, dal motore AF al processore d’immagine, contribuisce alla qualità del risultato finale in modo che non può essere isolato dagli altri. Una fotocamera con un sensore eccellente ma un processore mediocre produrrà risultati peggiori di una con sensore e processore entrambi di buon livello. Un sistema AF sofisticato è inutile se il motore dell’ottica non è abbastanza veloce da tradurre i suoi comandi in movimento delle lenti con la necessaria prontezza.

La comprensione del sistema complessivo è quindi più utile della conoscenza isolata di ciascun componente. Il fotografo che capisce come il segnale fluisce dal fotodiodo al file JPEG, dove si accumulano le perdite di qualità e dove risiedono i margini di miglioramento, è nelle condizioni di fare scelte informate: su quale formato di file usare, su come impostare i parametri di riduzione del rumore in camera, su quando fidarsi dell’autofocus automatico e quando intervenire manualmente. La tecnologia digitale ha reso la fotografia più accessibile e più immediata, ma non ha reso superflua la conoscenza tecnica: l’ha semplicemente spostata da una serie di abilità manuali a una comprensione dei sistemi di elaborazione dell’informazione visiva.

Sono Manuela, autrice e amministratrice del sito web www.storiadellafotografia.com. La mia passione per la fotografia è nata molti anni fa, e da allora ho dedicato la mia vita professionale a esplorare e condividere la sua storia affascinante.

Con una solida formazione accademica in storia dell’arte, ho sviluppato una profonda comprensione delle intersezioni tra fotografia, cultura e società. Credo fermamente che la fotografia non sia solo una forma d’arte, ma anche un potente strumento di comunicazione e un prezioso archivio della nostra memoria collettiva.

La mia esperienza si estende oltre la scrittura; curo mostre fotografiche e pubblico articoli su riviste specializzate. Ho un occhio attento ai dettagli e cerco sempre di contestualizzare le opere fotografiche all’interno delle correnti storiche e sociali.

Attraverso il mio sito, offro una panoramica completa delle tappe fondamentali della fotografia, dai primi esperimenti ottocenteschi alle tecnologie digitali contemporanee. La mia missione è educare e ispirare, sottolineando l’importanza della fotografia come linguaggio universale.

Sono anche una sostenitrice della conservazione della memoria visiva. Ritengo che le immagini abbiano il potere di raccontare storie e preservare momenti significativi. Con un approccio critico e riflessivo, invito i miei lettori a considerare il valore estetico e l’impatto culturale delle fotografie.

Oltre al mio lavoro online, sono autrice di libri dedicati alla fotografia. La mia dedizione a questo campo continua a ispirare coloro che si avvicinano a questa forma d’arte. Il mio obiettivo è presentare la fotografia in modo chiaro e professionale, dimostrando la mia passione e competenza. Cerco di mantenere un equilibrio tra un tono formale e un registro comunicativo accessibile, per coinvolgere un pubblico ampio.