Il controllo della luce ha cessato da tempo di essere un mero esercizio di chimica applicata per trasformarsi in una rigorosa computazione quantistica della radiazione elettromagnetica. La transizione storica dai sali d’argento alle matrici di silicio non ha semplicemente modificato il supporto di memorizzazione dell’immagine, ma ha ridefinito la natura stessa della misurazione della luminanza. Nel diciannovesimo secolo la reazione fotochimica si basava sulla riduzione degli alogenuri d’argento esposti alla radiazione luminosa, un processo intrinsecamente non lineare in cui la densità ottica del negativo rispondeva alla curva caratteristica del materiale secondo una progressione logaritmica naturale. Questa transizione trova il suo fondamento scientifico e storico nelle prime sperimentazioni sui materiali fotosensibili, i cui dettagli sono custoditi presso gli archivi storici della Fondazione Alinari, istituzione fondamentale per comprendere la nascita dell’iconografia fotografica. L’avvento dei sensori a stato solido ha introdotto una risposta perfettamente lineare all’energia radiante, dove il numero di elettroni accumulati all’interno di ciascun sito fotosensibile risulta direttamente proporzionale al numero di fotoni incidenti durante l’intervallo di tempo definito dal tempo di esposizione. Questa linearità intrinseca ha imposto lo sviluppo di algoritmi di demosaicizzazione estremamente complessi, necessari per convertire i dati grezzi estratti dalla matrice a mosaico di filtri colorati nello spazio colore di destinazione.

La geometria del sensore contemporaneo determina la capacità di quantizzazione del segnale luminoso prima ancora che intervenga l’elettronica di lettura. Ogni singolo pixel si configura come una struttura tridimensionale microscopica dotata di una microlente superiore, il cui scopo risiede nel massimizzare il fattore di riempimento convogliando i fotoni verso l’area attiva del fotodiodo. Nei sensori a tecnologia tradizionale a illuminazione frontale la presenza delle piste circuitali metalliche al di sopra dello strato fotosensibile riduceva l’efficienza quantica complessiva, limitando la sensibilità massima e generando fenomeni di cross-talk tra pixel adiacenti. L’introduzione dei sensori retroilluminati ha invertito questa architettura strutturale, posizionando la logica di lettura e i collegamenti elettrici al di sotto del substrato di silicio fotosensibile, consentendo alla luce di colpire direttamente la zona di svuotamento del diodo. Questo incremento dell’efficienza quantica ha ridefinito il concetto stesso di rapporto segnale rumore, estendendo la capacità della fotocamera di registrare dettagli utili sia nelle ombre più profonde sia nelle altissime luci. Il fotografo professionista e il direttore della fotografia devono comprendere che la dinamica di un sensore non è un valore statico, bensì una grandezza fluidamente legata alla capacità di accumulo di carica del singolo pixel, definita tecnicamente come full-well capacity. Quando questa capacità viene superata, il pixel satura bruscamente, provocando il fenomeno del clipping del segnale, una transizione digitale distruttiva che cancella qualsiasi informazione cromatica e di luminanza.

La gestione della transizione cromatica richiede l’utilizzo di filtri ottici passa-basso dedicati, posizionati immediatamente sopra il sensore per prevenire l’insorgenza del fenomeno del moiré e dell’alleasing spaziale. Questi filtri distribuiscono la luce incidente su un’area leggermente più ampia, riducendo le frequenze spaziali superiori alla frequenza di Nyquist del sensore stesso. Alcuni produttori hanno scelto di eliminare tale componente per privilegiare la massima nitidezza microcontrastata, demandando la correzione degli artefatti geometrici ai software di sviluppo del file negativo digitale. La comprensione di queste dinamiche fisiche risulta imprescindibile quando si opera in condizioni di illuminazione critiche, dove la scomposizione della luce richiede una precisione micrometrica per evitare derive cromatiche distruttive nelle aree di transizione tonale.

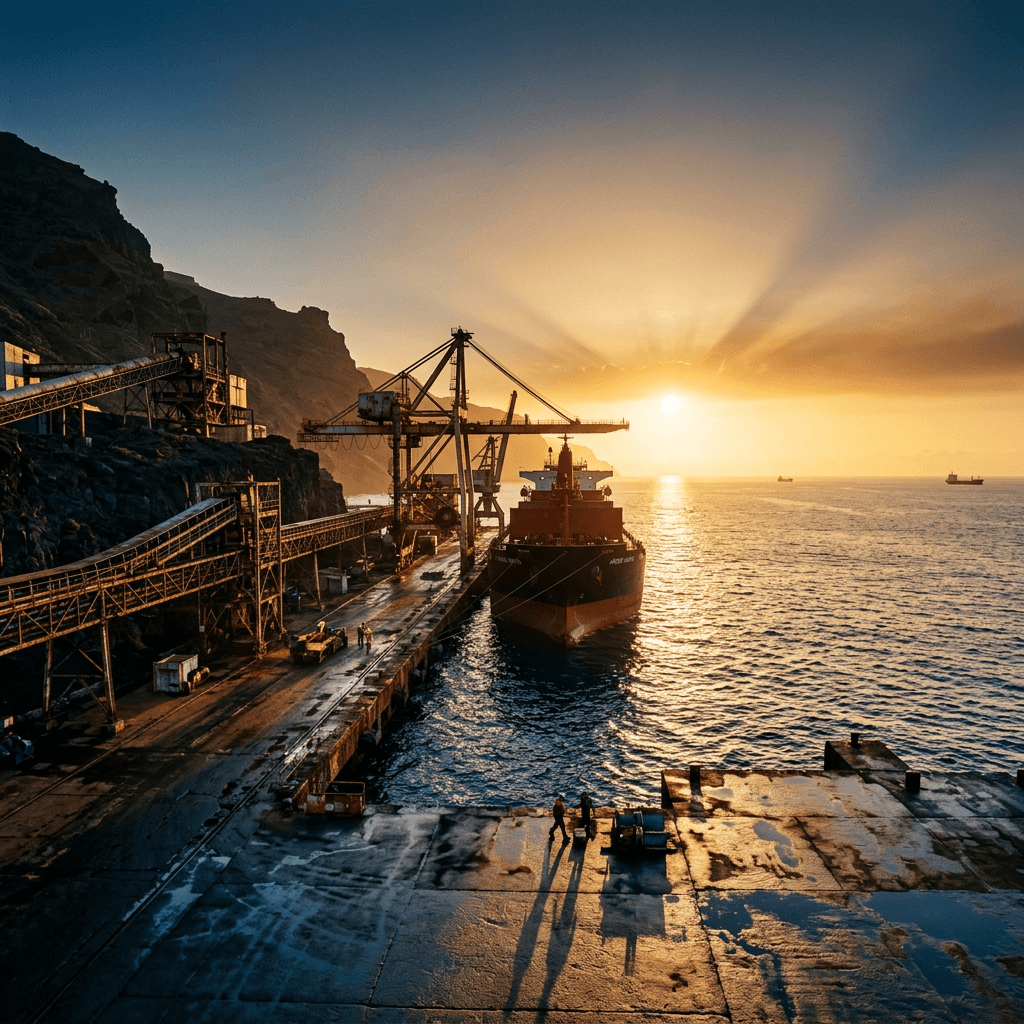

La fisica della radiazione solare nella transizione d’orizzonte

La definizione scientifica di magic hour prescinde dalle interpretazioni romantiche della letteratura per focalizzarsi sulla complessa interazione ottica tra lo spessore dell’atmosfera terrestre e l’angolo di incidenza dei raggi solari. Quando il centro geometrico del disco solare si trova tra i quattro gradi sopra l’orizzonte e i sei gradi al di sotto di esso, il percorso ottico dei fotoni attraverso la stratosfera e la troposfera aumenta considerevolmente rispetto allo zenit. Questo fenomeno determina una drastica diffusione di Rayleigh, la quale disperde le lunghezze d’onda più corte dello spettro visibile, corrispondenti allo spettro del blu e del viola, consentendo il transito selettivo delle lunghezze d’onda più estese, quantificabili tra i seicento e i settecentocinquanta nanometri, riconducibili alle tonalità calde dell’arancione e del rosso. Contemporaneamente la porzione di cielo opposta al punto di tramonto o di alba riceve la luce riflessa dagli strati superiori dell’atmosfera, arricchendosi di tonalità fredde e generando un contrasto simultaneo intrinseco che costituisce il fondamento della separazione cromatica tridimensionale nella cinematografia.

Durante questa fase la luce solare diretta subisce una fortissima attenuazione, trasformando l’intera volta celeste in una gigantesca sorgente diffusa la cui temperatura colore varia costantemente, scendendo repentinamente dai circa cinquemila rating Kelvin della luce diurna standard fino ai tremila Kelvin durante il picco dorato, per poi risalire oltre gli ottomila Kelvin nella successiva ora blu. Questa mutevolezza impone una costante ricalibrazione del bilanciamento del bianco per evitare che l’elettronica della fotocamera compensi erroneamente l’intenzionalità espressiva della luce naturale. Operare con un bilanciamento impostato rigidamente sul valore di 5600K permette di preservare la progressiva saturazione delle componenti calde, mentre l’utilizzo di automatismi distruggerebbe la dominanza cromatica naturale vanificando le peculiarità termiche del momento. La riduzione del contrasto intrinseco della scena consente al sensore di operare all’interno del proprio intervallo ottimale di linearità, minimizzando la distanza tra la massima luminanza registrabile e il rumore di fondo del sistema.

La dinamica dell’illuminazione naturale in questi frangenti riduce i rapporti di contrasto tradizionali, portando l’intervallo tra le ombre e le luci entro valori facilmente gestibili dai moderni sistemi di ripresa senza la necessità di ricorrere a pannelli riflettenti o illuminatori artificiali di schiarita. Le ombre si allungano a dismisura e perdono la loro durezza geometrica, poiché i contorni della penombra si ampliano a causa della dimensione angolare estesa della sorgente celeste. Questa diffusione omnidirezionale avvolge i volumi dei soggetti esaltandone la microstruttura superficiale senza generare riflessi speculari distruttivi sulle superfici lucide. La rifrazione atmosferica agisce inoltre come un gigantesco filtro polarizzatore naturale, saturando i toni del cielo e riducendo la diffusione parassita causata dal particolato in sospensione, a patto che l’asse di ripresa sia orientato perpendicolarmente rispetto alla direzione dei raggi solari originari. La comprensione geometrica di questi vettori luminosi consente al fotografo di pianificare lo scatto posizionando la fotocamera non solo in funzione della composizione geometrica, ma anche in base alla cinematica dei corpi celesti.

Architetture logaritmiche e quantizzazione del segnale video

La memorizzazione efficace delle informazioni tonali registrate durante le variazioni repentine di luce richiede l’abbandono dei sistemi di codifica lineare a otto bit, strutturalmente insufficienti a contenere la latitudine di posa dei sensori moderni senza incorrere in fenomeni di posterizzazione visibile nelle sfumature del cielo. I profili di ripresa lineari distribuiscono i livelli di quantizzazione in modo geometrico, assegnando la metà dei valori disponibili all’intervallo di stop più luminoso e riducendo drasticamente il numero di bit destinati alle ombre profonde. Per ovviare a questo limite i produttori cinematografici hanno sviluppato le curve di trasferimento logaritmiche, comunemente denominate profili log, le quali rimappano i valori di luminanza imitando la risposta sensitometrica dell’occhio umano e delle pellicole analogiche tradizionali. L’adozione di un profilo come il Sony S-Log3, il Canon Log 2 o l’ARRI LogC4 permette di distribuire i livelli di quantizzazione in modo uniforme lungo tutti gli stop di esposizione della fotocamera, garantendo una preservazione ottimale sia del dettaglio nel fogliame in ombra sia delle sfumature cromatiche presenti nelle nubi illuminate dal sole calante. Per approfondire le specifiche matematiche di queste conversioni, è possibile consultare i white paper tecnici forniti direttamente dalla Sony Service and Support, dove vengono dettagliate le matrici di trasformazione per i flussi di lavoro cinematografici.

L’utilizzo pratico di queste architetture curve richiede una comprensione rigorosa della tecnica cinematografica per evitare l’insorgenza di rumore di quantizzazione indotto da una sottoesposizione macroscopica del sensore. Quando si registra in formato logaritmico, l’esposizione non deve basarsi sulla valutazione visiva del monitor di servizio, il quale mostrerebbe un’immagine apparentemente sbiadita, priva di contrasto e desaturata, ma deve essere monitorata accuratamente mediante l’ausilio dello strumento monitor forma d’onda e dell’istogramma in tempo reale. Molti direttori della fotografia adottano la strategia espositiva comunemente definita Expose To The Right, posizionando l’istogramma verso il limite destro del grafico senza superare la soglia di saturazione dei fotodiodi. Questa metodologia massimizza il rapporto segnale rumore, accumulando il maggior numero possibile di informazioni nelle aree ad alta densità del sensore, per poi ridefinire i corretti rapporti di contrasto durante la fase di sviluppo del file e successiva color grading. In fase di post-produzione l’applicazione di una tabella di consultazione bidimensionale o tridimensionale, nota come 3D LUT, consentirà di riportare lo spazio colore logaritmico originario all’interno dello standard di visualizzazione Rec709 o del più esteso spazio di colore ad alta dinamica BT.2020.

La compressione del file video introduce un ulteriore livello di complessità legato alla struttura del sottocampionamento della crominanza e alla tipologia del codec utilizzato. Le fotocamere destinate alla produzione cinematografica consentono la registrazione con un campionamento del segnale quantificato in 4:2:2 a 10 bit, il che significa che per ogni blocco di quattro pixel orizzontali le informazioni di luminanza vengono registrate interamente, mentre le informazioni di colore vengono dimezzate sull’asse orizzontale ma preservate interamente su quello verticale. Questo approccio garantisce una fedeltà cromatica nettamente superiore rispetto al formato standard 4:2:0 a 8 bit tipico dei flussi di lavoro broadcast ed amatoriali, dove la compressione del colore impedisce l’esecuzione di interventi marcati sulle curve di viraggio cromatico senza distruggere la coerenza spaziale dei pixel. La scelta del codec influisce direttamente sulla stabilità del bitrate e sul carico computazionale richiesto dalle stazioni di montaggio. I sistemi di compressione intra-frame registrano ogni singolo fotogramma come un’entità indipendente, garantendo la massima fedeltà strutturale al prezzo di un utilizzo massiccio dello spazio di archiviazione, mentre i codec inter-frame memorizzano esclusivamente i vettori di movimento e le differenze macroscopiche tra fotogrammi chiave successivi, ottimizzando l’efficienza a scapito della precisione nei dettagli in rapido mutamento spaziale.

Esposimetria scientifica e calibrazione della gamma dinamica

La determinazione del corretto punto di esposizione durante una transizione luminosa repentina richiede l’abbandono delle modalità di lettura valutativa o d’insieme integrate nei sistemi esposimetrici delle fotocamere contemporanee. L’utilizzo di un esposimetro esterno a luce incidente dotato di semisfera integratrice rappresenta lo strumento fondamentale per misurare l’esatta quantità di radiazione fotometrica che colpisce il soggetto, indipendentemente dalla riflettanza della sua superficie o dalla presenza di sfondi fortemente contrastati. Quando la luce del sole cala, il valore dell’illuminamento diminuisce secondo una progressione geometrica non lineare, costringendo l’operatore a una continua regolazione dei parametri di ripresa della fotocamera. Per mappare accuratamente la latitudine di posa del sensore si ricorre all’ausilio di un cartoncino grigio neutro con riflettanza calibrata al 18%, posizionato all’interno della scena in modo da ricevere la medesima illuminazione del soggetto principale. Misurando questo punto di riferimento tramite la funzione di lettura spot della fotocamera, l’operatore è in grado di stabilire il valore dell’esposizione base attorno al quale distribuire gli stop di dinamica disponibili sia verso le alte luci sia verso le ombre profonde.

L’analisi visiva delle variazioni di contrasto viene eseguita monitorando costantemente l’interfaccia dello strumento monitor forma d’onda, il quale visualizza graficamente l’andamento della luminanza lungo l’asse orizzontale dell’inquadratura. A differenza dell’istogramma convenzionale, che mostra esclusivamente la distribuzione statistica complessiva dei pixel senza alcuna informazione sulla loro collocazione geometrica, il monitor forma d’onda permette di identificare esattamente quale porzione del cielo stia raggiungendo il livello di saturazione espresso in unità IRE. All’interno di questa scala il valore di 0 IRE rappresenta il nero assoluto privato di segnale elettrico, mentre il valore di 100 IRE identifica il limite massimo di bianco puro quantizzabile nel sistema standard. Quando si opera con curve di tipo logaritmico, il punto di corrispondenza del grigio medio al diciotto percento viene intenzionalmente spostato verso il basso, collocandosi generalmente tra i 32 IRE e i 45 IRE a seconda delle specifiche del produttore del sensore. Questa calibrazione artificiale consente di allocare una porzione maggiore della scala di quantizzazione alla memorizzazione dei sovrallivelli di esposizione, salvaguardando la riproduzione delle sfumature cromatiche calde presenti nel cielo ed evitando l’appiattimento tonale dei dettagli delle nuvole.

L’ottimizzazione del rapporto di contrasto implica una scelta strategica riguardante la sensibilità ISO nativa del sensore. Molti sensori moderni implementano la tecnologia del doppio ISO nativo, integrando due circuiti di amplificazione analogica distinti a valle di ciascun pixel. Il primo circuito viene ottimizzato per garantire la massima dinamica e il minor rumore possibile in condizioni di forte illuminazione ambientale, mentre il secondo circuito interviene a sensibilità più elevate modificando il guadagno analogico prima della conversione analogico-digitale, riducendo drasticamente il rumore termico e il rumore di lettura senza penalizzare eccessivamente la latitudine di posa complessiva. Selezionare accuratamente il valore ISO nativo secondario permette di continuare a operare durante l’ora blu mantenendo tempi di posa compatibili con il movimento dei soggetti e aperture di diaframma idonee a preservare la profondità di campo desiderata, evitando l’insorgenza di quell’artefatto digitale granulare che distruggerebbe la nitidezza delle trame d’ombra.

Cromatismo ottico e diffrazione geometrica nei sistemi a grande formato

La scelta dell’ottica e la gestione geometrica dell’apertura del diaframma determinano la purezza della scomposizione della luce prima che questa intercetti la superficie sensibile del sensore. Quando si fotografa o si riprende durante la transizione dell’orizzonte, la presenza del sole all’interno o immediatamente al di fuori del fotogramma introduce il rischio di insorgenza di fenomeni ottici parassiti, quali il flare e le immagini fantasma causate dalle riflessioni interne tra gli elementi vitrei dell’obiettivo. Le lenti moderne adottano trattamenti antiriflesso multistrato avanzati, progettati per ridurre l’indice di rifrazione superficiale dei singoli elementi e massimizzare la trasmittanza complessiva della luce. Tuttavia l’inclinazione estrema dei raggi luminosi tipica di questo periodo della giornata può generare una perdita generalizzata di contrasto a causa del velo ottico, un fenomeno che riduce la purezza dei neri e maschera le micro-informazioni tessiturali registrate nelle ombre. Per mitigare questo effetto l’utilizzo di paraluce rigidi calcolati specificamente per la lunghezza focale in uso si rivela una procedura operativa fondamentale per escludere i raggi fuori asse non utili alla formazione dell’immagine.

L’interazione tra l’apertura del diaframma e la risoluzione ottica è regolata dalle leggi fisiche della diffrazione ottica, un fenomeno geometrico che si manifesta quando le onde luminose transitano attraverso un’apertura circolare ristretta, subendo una deviazione che ne altera la propagazione lineare. Ogni punto luminoso viene proiettato sul sensore non come un punto geometrico infinitesimale, bensì come un pattern di diffrazione noto come disco di Airy. Quando l’apertura del diaframma viene chiusa a valori estremi come f/16 o f/22, il diametro del disco di Airy si amplia fino a superare la dimensione fisica del singolo pixel del sensore, provocando un ammorbidimento generalizzato dei dettagli minuti dell’immagine che annulla i vantaggi offerti dalle matrici ad alta risoluzione. Al contrario l’utilizzo di aperture eccessivamente ampie come f/1.4 o f/2.0 introduce aberrazioni sferiche e cromatismo assiale, limitando la nitidezza ai soli settori centrali dell’inquadratura. Per massimizzare l’incisione dei dettagli del paesaggio e mantenere una corretta nitidezza da bordo a bordo, l’ottimizzatore deve individuare l’apertura ottimale dell’obiettivo, generalmente collocata tra f/5.6 e f/11, intervallo in cui le aberrazioni geometriche risultano corrette e l’impatto della diffrazione rimane confinato al di sotto della soglia visibile.

L’adozione di sistemi fotografici basati sul grande formato o sul medio formato digitale introduce ulteriori parametri di calcolo nella gestione dello spazio tridimensionale. I sensori le cui dimensioni superano lo standard del formato nativo da trentasei per ventiquattro millimetri offrono una resa prospettica differente a parità di angolo di campo, imponendo l’utilizzo di lunghezze focali maggiori per ottenere la medesima inquadratura spaziale. Questa configurazione ottica riduce intrinsecamente la profondità di campo effettiva, amplificando la separazione tra il soggetto principale e lo sfondo attraverso una transizione dello sfocato estremamente progressiva e naturale. La comprensione approfondita dei principi dell’ottica geometrica e ondulatoria trova un solido riscontro scientifico nelle pubblicazioni storiche e tecniche fornite dalla Optical Society of America, risorsa indispensabile per lo studio dei sistemi di rifrazione complessi e delle aberrazioni cromatoche nei materiali vetrosi di ultima generazione. L’interazione tra la dimensione fisica del sensore e la qualità intrinseca delle lenti determina l’efficacia del trasferimento della funzione di modulazione ottica, definendo la capacità del sistema di risolvere dettagli ad altissima frequenza spaziale senza generare artefatti di campionamento.

Tecniche di demosaicizzazione e sviluppo del negativo digitale

Il processo di conversione del file grezzo estratto dal sensore rappresenta una fase critica in cui le decisioni ingegneristiche e software influenzano direttamente la resa cromatica e la fedeltà del dettaglio fine. I dati registrati dalla matrice dei fotodiodi sono privi di informazioni sul colore pixel per pixel, poiché ogni sito fotosensibile registra esclusivamente un valore di intensità luminosa filtrato da un singolo colore primario secondo lo schema del filtro di Bayer. L’algoritmo di demosaicizzazione deve interpolare matematicamente i valori cromatici mancanti analizzando i pixel adiacenti per ricostruire la terna cromatica completa per ogni singola coordinata spaziale dell’immagine. Questa complessa operazione computazionale viene eseguita all’interno del software di sviluppo del file raw, come Adobe Lightroom o DaVinci Resolve, dove l’utente seleziona i parametri fondamentali di interpretazione del segnale attraverso il controllo del motore di rendering interno. Un’errata impostazione di questi algoritmi può introdurre artefatti di aliasing cromatico lungo i bordi ad alto contrasto o generare falsi colori nelle trame tessili ad alta densità spaziale.

Durante la fase di sviluppo l’operatore agisce direttamente sulle curve di viraggio tonale per compensare la compressione dinamica operata in fase di ripresa con i profili logaritmici. Il controllo dello strumento di regolazione dei punti di bianco e di nero consente di ridefinire gli estremi della gamma dinamica all’interno dello spazio colore di destinazione, assicurando che le ombre profonde non vengano tagliate verso il nero puro e che le alte luci mantengano la consistenza cromatico-strutturale originaria. La gestione della saturazione dei colori deve essere eseguita preferibilmente agendo sui controlli di vividezza o attraverso la calibrazione selettiva delle singole costanti cromatiche, evitando incrementi globali che provocherebbero la saturazione distruttiva dei canali più sollecitati, in particolare del canale del rosso e del canale del verde durante lo sviluppo di immagini catturate nella fase dorata del tramonto. L’utilizzo di spazi di lavoro interni estremamente ampi, come il formato ProPhoto RGB o l’ACEScc cinematografico, garantisce che nessuna informazione cromatica estratta dal sensore venga persa a causa di limitazioni geometriche del gamut software prima dell’esportazione finale del file nel formato di distribuzione standard.

La calibrazione fine del rumore elettronico deve essere integrata all’interno del flusso di sviluppo digitale sfruttando le funzioni di riduzione del rumore a stima del profilo basate sull’analisi statistica della grana. Il rumore si divide principalmente in rumore di crominanza, caratterizzato da fluttuazioni casuali del colore che appaiono come pixel spuri di tonalità magenta o verde nelle zone d’ombra, e rumore di luminanza, che si manifesta come una fine granulosità strutturale priva di alterazioni cromatiche parassite. La riduzione del rumore di crominanza può essere applicata in modo aggressivo poiché l’occhio umano risulta meno sensibile alle variazioni spaziali del colore rispetto a quelle di luminanza, mentre la riduzione del rumore di luminanza deve essere calibrata con estrema parsimonia per evitare la cancellazione dei dettagli tessiturali minimi e delle micro-informazioni geometriche del soggetto. La preservazione di una leggera componente di rumore di luminanza coerente contribuisce a mantenere una percezione di nitidezza soggettiva più elevata e conferisce all’immagine digitale un aspetto organico affine alla grana delle emulsioni cinematografiche tradizionali.

.

Flussi di lavoro cinematografici nella post-produzione del colore

La fase finale della manipolazione dell’immagine cinematografica e fotografica digitale si compie all’interno dell’ambiente di color grading, dove le scelte tecniche operate sul set vengono finalizzate per supportare l’intenzionalità narrativa del progetto. Il flusso di lavoro contemporaneo prevede la strutturazione del progetto all’interno di nodi sequenziali o paralleli all’interno del software DaVinci Resolve, ciascuno deputato all’esecuzione di una specifica operazione correttiva o creativa sul segnale video. Il primo nodo viene costantemente dedicato alla correzione primaria dell’esposizione e del bilanciamento cromatico generale, eliminando eventuali derive introdotte da variazioni repentine dell’illuminazione solare durante le sessioni di ripresa prolungate. Questa fase iniziale assicura la coerenza visiva tra inquadrature differenti destinate a far parte della medesima sequenza temporale, stabilendo una base neutra ed omogenea prima di procedere alle successive manipolazioni estetiche del contrasto e della saturazione. Per approfondire l’evoluzione di queste tecnologie e consultare materiale storiografico sul cinema d’autore, si veda la cineteca digitale dell’Istituto Luce Cinecittà, risorsa d’eccellenza per lo studio della fotografia cinematografica nazionale ed internazionale.

Il passaggio successivo prevede l’esecuzione di correzioni secondarie mirate all’isolamento geometrico e cromatico di specifiche aree del fotogramma attraverso l’utilizzo di maschere parametriche tracciate in tempo reale mediante algoritmi di motion tracking vettoriale. Durante la post-produzione di immagini catturate durante la transizione dell’orizzonte, risulta frequente la necessità di isolare la tonalità della pelle del soggetto rispetto alle dominanti fredde dello sfondo tipiche dell’ora blu. Utilizzando lo strumento di selezione basato sulla tonalità, sulla saturazione e sulla luminanza, l’operatore può applicare una correzione selettiva che restituisca calore e presenza ai volumi del volto senza alterare la resa cromatica del cielo circostante. Questa separazione viene ulteriormente affinata modificando i parametri di contrasto locale o applicando filtri di sfocatura controllata per simulare la risposta ottica di lenti cinematografiche d’epoca caratterizzate da una transizione più morbida fuori dal piano di messa a fuoco focale.

La fase creativa del trattamento del colore si avvale dell’applicazione di look personalizzati sviluppati mediante la manipolazione delle curve di miscelazione dei canali RGB indipendenti. L’estetica cinematografica contemporanea fa ampio uso della tecnica denominata teal and orange, la quale esaspera il contrasto simultaneo spingendo le ombre profonde verso le tonalità complementari del ciano e del blu, mantenendo i toni caldi della pelle ancorati all’asse dell’arancione e del giallo. Questa scelta stilistica trova un riscontro ideale nelle riprese effettuate durante la transizione luminosa serale, poiché ricalca e amplifica le relazioni cromatiche già naturalmente presenti nell’atmosfera terrestre in quel determinato frangente temporale. L’operatore deve tuttavia evitare eccessi artificiali che provocherebbero la distruzione della verosimiglianza fotorealistica, monitorando costantemente lo strumento vettorscopio per verificare che l’estensione dei vettori di saturazione non superi i limiti di sicurezza definiti per la trasmissione televisiva o la proiezione in sala secondo le specifiche internazionali dello standard del consorzio per lo sviluppo dei formati d’immagine.

L’esportazione finale del file richiede la selezione accurata del contenitore e del codec di destinazione in funzione della piattaforma di distribuzione prevista per l’opera. Per la proiezione cinematografica digitale il materiale viene convertito nel formato standard Digital Cinema Package, che impiega una compressione basata sull’algoritmo JPEG 2000 codificato nello spazio colore XYZ a dodici bit per componente cromatica, garantendo la totale assenza di artefatti visibili su schermi di grande formato. Per la distribuzione web o televisiva ad alta definizione si privilegiano codec ad alta efficienza come l’H.264 o il successivo H.265, configurando i parametri di compressione in modalità a bitrate variabile con doppia passata per ottimizzare la distribuzione dei dati nelle scene caratterizzate da elevata complessità spaziale o da movimenti rapidi della fotocamera. La padronanza di ciascuno di questi passaggi tecnici permette al fotografo e al regista di trasformare la registrazione documentale della luce naturale in un’opera visiva dotata di coerenza formale, rigore scientifico e duraturo valore storico.

Fonti

Archivio Storico Fondazione Alinari, Firenze, Italia. https://www.alinari.it

White Papers on Digital Cinematography, Sony Service and Support. https://pro.sony

Journal of the Optical Society of America, System Optics Section. https://www.optica.org

Archivio Storico e Cineteca Digitale Istituto Luce Cinecittà, Roma, Italia. https://www.cinecitta.com

Adams, A. (1981). The Negative. New York Graphic Society. ISBN 978-0821211311.

Blain, B. (2019). Cinematography: Theory and Practice. Routledge. ISBN 978-0132485883.

Poynton, C. (2012). Digital Video and HD: Algorithms and Interfaces. Morgan Kaufmann. ISBN 978-0123919267.

Stump, D. (2014). Digital Cinematography: Fundamentals, Tools, Techniques, and Workflows. Focal Press. ISBN 978-0240817910.

Sono Marco Sollazzi, ricercatore e collaboratore nel campo della storia della fotografia, con una formazione che unisce analisi tecnica e approccio storico-scientifico. Dopo aver conseguito la laurea in Ingegneria e aver seguito percorsi specialistici in storia della tecnologia, ho maturato un’esperienza decennale nell’analisi critica dei processi produttivi e delle innovazioni che hanno plasmato il mondo della fotografia.

La mia passione nasce dal desiderio di svelare i retroscena tecnici del medium fotografico, esaminandone il funzionamento e l’evoluzione nel tempo: ritengo che la fotografia sia il risultato di un complesso intreccio tra innovazione tecnologica, scienza dei materiali e ingegneria di precisione. Su storiadellafotografia.com mi occupo della storia della fotografia con un approccio che privilegia la dimensione tecnica e scientifica, raccontando come ogni innovazione abbia trasformato non solo gli strumenti ma il linguaggio visivo stesso.

Curo gli approfondimenti fotografici dedicati ai generi fotografici, analizzando ritratto, paesaggio, reportage, fotografia scientifica e tutti gli altri filoni in cui il medium si è sviluppato nel corso della sua storia. Gestisco la rubrica L’esperto risponde, dove metto la mia formazione ingegneristica al servizio dei lettori che cercano risposte precise e documentate su questioni tecniche, storiche e pratiche legate alla fotografia.

Curo inoltre le appendici del sito, gli strumenti di approfondimento e i riferimenti documentali che completano e arricchiscono i contenuti principali. Ho collaborato con istituzioni accademiche e centri di ricerca, partecipando a progetti sull’impatto delle tecnologie fotografiche sullo sviluppo della comunicazione visiva, e continuo a condividere le mie ricerche attraverso conferenze, pubblicazioni e workshop.